关于“Chat With RTX”人工智能聊天机器人的一切知识

虽然生成式人工智能聊天机器人已经存在了几年,但由于黑客从服务器访问此类信息,所有这些机器人都依赖于云处理,这给处理敏感数据带来了挑战。针对这个问题,Nvidia 推出了自己的 AI 聊天机器人,名为“Chat with RTX”,使用户能够在没有互联网连接的情况下在自己的计算机上托管个性化的 AI 聊天机器人。这是您需要了解的一切。

先决条件

在深入研究具体细节之前,重要的是要了解 Chat with RTX 是一个可在您的 PC 上下载的独立应用程序。因此,它需要至少 40GB 的可用空间和 RTX 30 或 40 系列 GPU,以及至少 8GB 的 VRAM。

现在我们已经解决了先决条件,让我们讨论一下您可以使用聊天机器人做什么。在 Mistral 或 Llama 2 AI 语言模型上运行(取决于您的偏好),潜在的应用程序非常重要,特别是在员工或记者的数据研究等领域,其中分析多个机密文档至关重要。

了解更多:如何修复 Microsoft Copilot 中的“登录以继续聊天”错误

除了文档分析之外,用户还可以输入视频 URL 并要求聊天机器人搜索特定提及的文字记录或创建全面的视频摘要。此外,与处理 PDF 的微软 Copilot 不同,Chat with RTX 聊天机器人可以轻松扫描 PDF 和事实检查数据。此外,近乎瞬时的响应时间可能使其成为许多专业人士最喜爱的新工具。

然而,值得注意的是,尽管聊天机器人具有这些功能,但仍处于测试阶段,并且存在一些错误和问题。其中包括聊天机器人下载随机视频副本、崩溃并显示不准确的源信息的情况。此外,聊天机器人目前缺乏上下文保留,需要用户开始新的聊天来解决后续问题。

如何安装 Chat with RTX 聊天机器人?

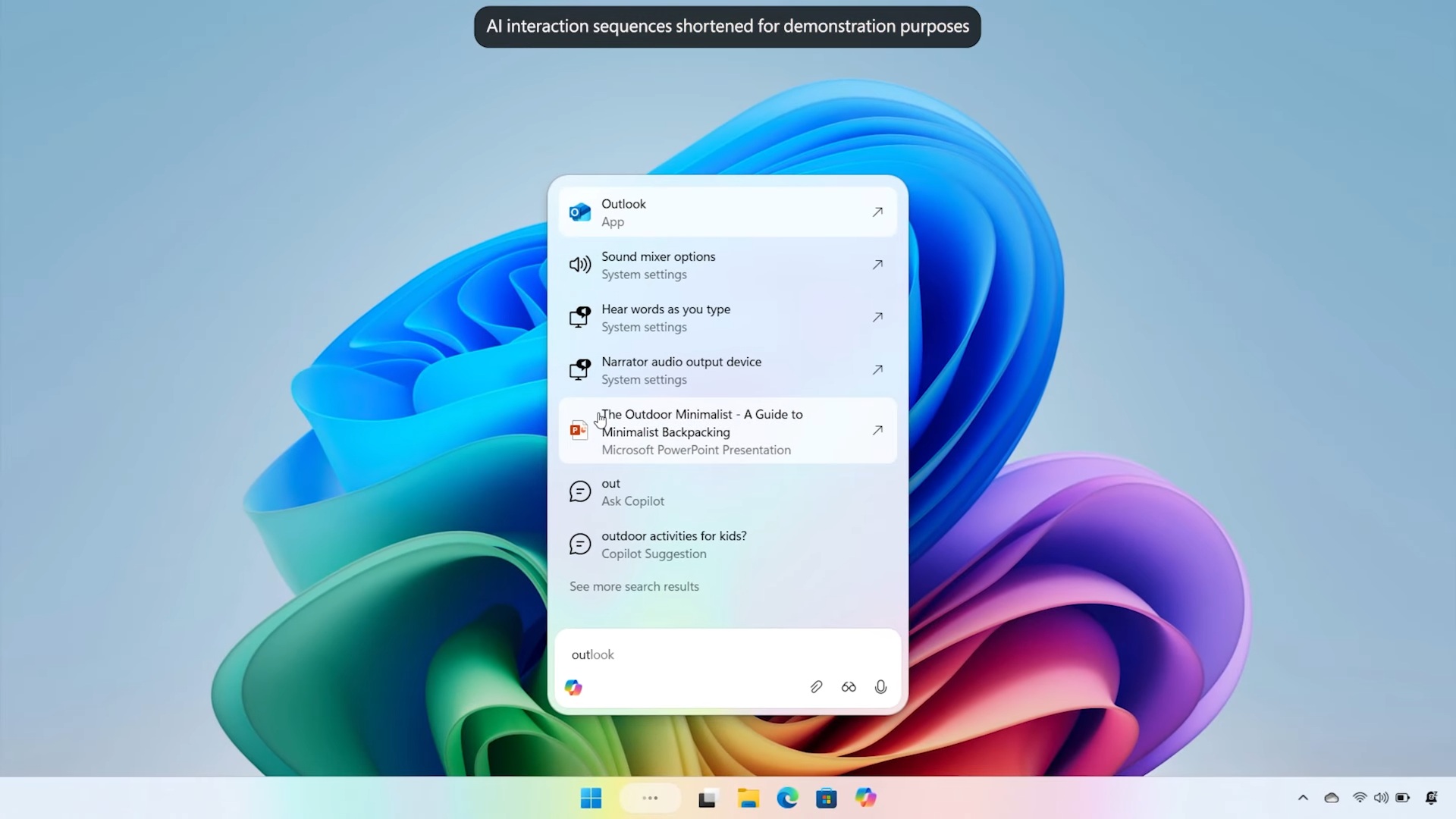

- 前往 Nvidia 的网站 [这里]。

- 检查系统要求并单击“立即下载”按钮。

- 打开文件并安装应用程序。