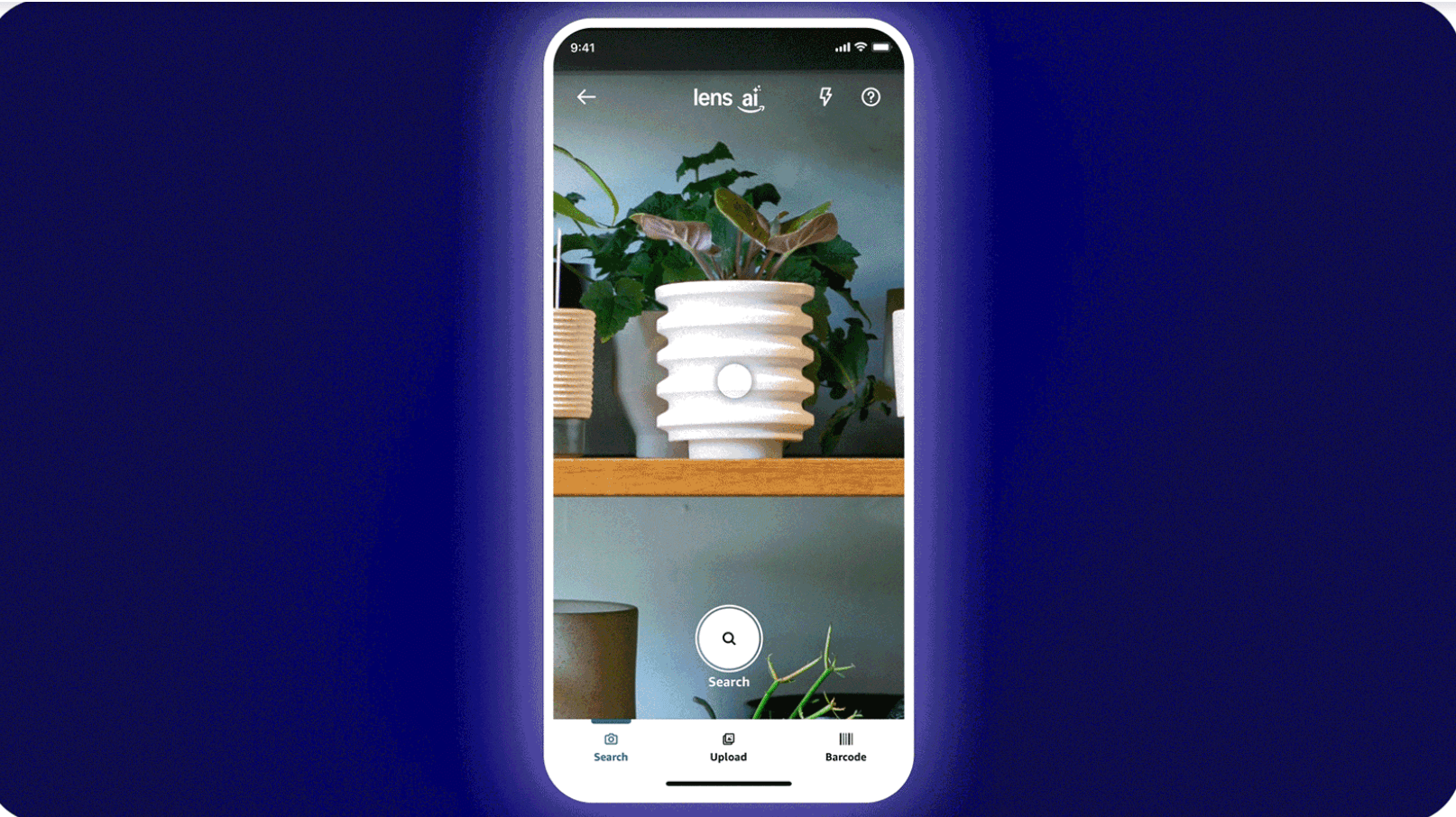

想像一下:你正走過鄰居漂亮的戶外花盆,你不用尷尬地問他們在哪裡買的,而是把手機對準它。亞馬遜會立即向您展示數十個類似的選項,包括價格和一鍵購買。這就是的承諾從今天開始,該功能將向數千萬 iOS 用戶推出。

這家零售巨頭的新工具將傳統的 Amazon Lens 體驗轉變為真正具有未來感的體驗。 Lens Live 不再採用舊的“快照並等待”的方法,而是在您打開相機的那一刻開始掃描產品,並在屏幕底部的可滑動輪播中顯示匹配的商品。視覺搜索實際上跟上了我們自然瀏覽周圍世界的方式。

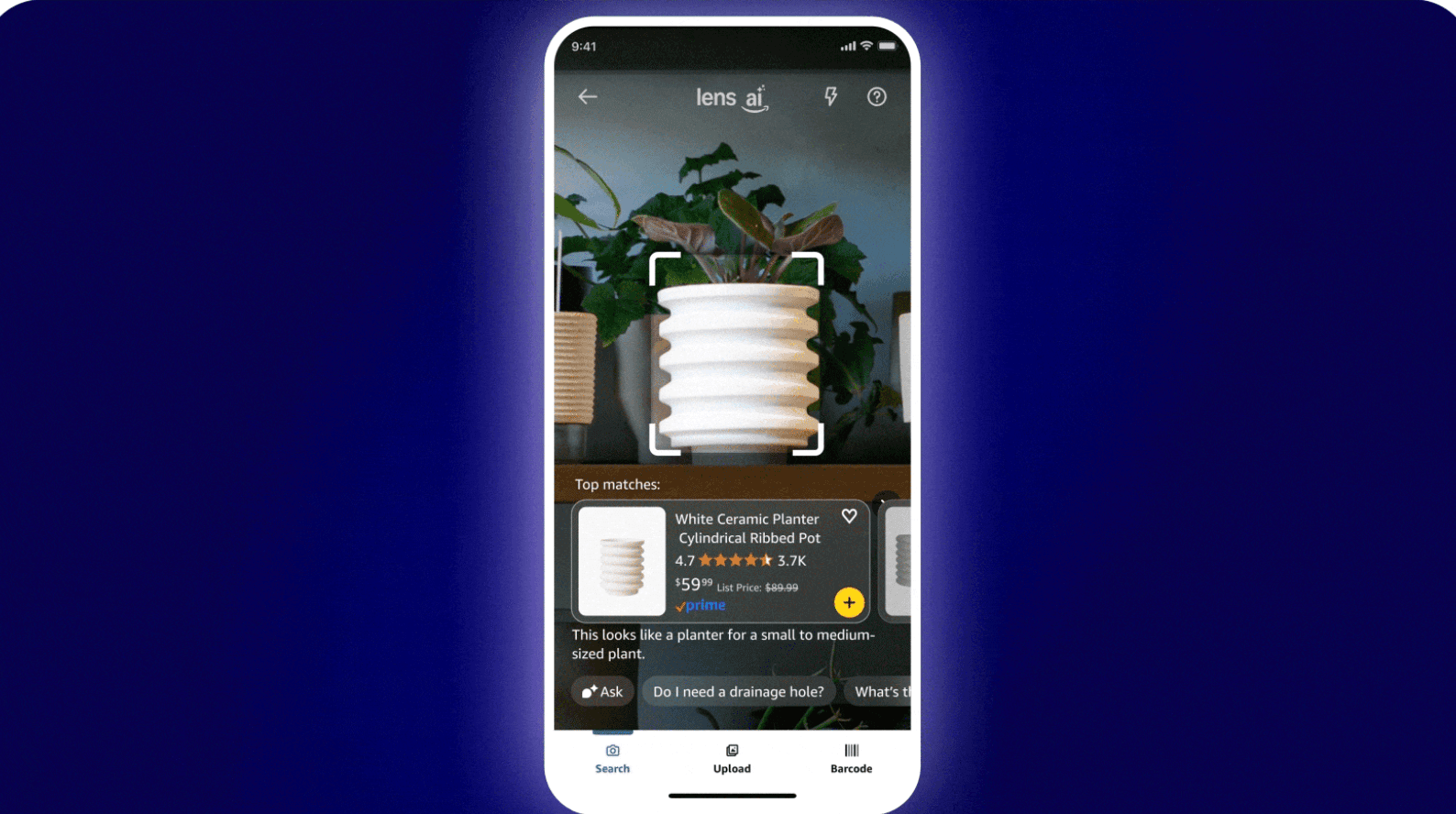

與之前的視覺搜索嘗試的不同之處不僅在於速度,還在於與。當您將相機對準陶瓷花盆時,魯弗斯會插話,提供上下文建議和總結,說明特定產品值得考慮的因素。 AI 助手可以回答有關材料、尺寸或保養說明的問題,而無需強迫您離開攝像頭視圖。

點擊展開

從本質上講,Lens Live 代表了移動人工智能領域的一項重大技術成就。該系統直接在您的設備上運行輕量級計算機視覺模型,實時識別對象,然後將其與亞馬遜目錄中的數十億產品進行匹配。這種設備上處理意味著初始檢測會立即發生,不會出現通常與基於雲的圖像識別相關的延遲。

點擊展開

Amazon 的工程團隊在 AWS 基礎設施上構建了該功能,利用 OpenSearch 和 SageMaker 大規模部署必要的機器學習模型。為匹配過程提供動力的視覺嵌入模型經過專門訓練,可以處理現實世界環境的混亂——變化的照明條件、局部視圖以及奇怪角度的產品,這些通常會混淆傳統的圖像識別系統。

與 Rufus 的集成又增加了一層複雜性。亞馬遜一直在全球穩步推出的購物助手使用大型語言模型來理解上下文並生成相關的產品見解。當與 Lens Live 結合使用時,它創造的購物體驗更像是有一位知識淵博的朋友幫助您瀏覽,而不僅僅是另一個搜索界面。

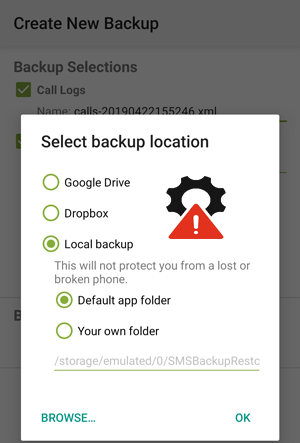

對於擔心傳統 Lens 功能消失的用戶,亞馬遜保留了所有現有選項。如果您願意,您仍然可以拍照、上傳現有圖像或掃描條形碼。該公司似乎明白不同的購物場景需要不同的方法——有時您希望在積極購物時立即獲得結果,有時您正在研究之前拍攝的照片。

推出策略表明亞馬遜對此次推出持謹慎態度。從數千萬 iOS 用戶開始可能聽起來規模很大,但對於亞馬遜這樣規模的公司來說,這實際上是一個受控部署。逐步擴展使他們能夠收集反饋並根據現實世界的使用模式完善人工智能模型。儘管亞馬遜承諾該功能將在未來幾個月內向所有美國客戶推出,但 Android 用戶將不得不等待更長的時間。

對於人工智能驅動的購物工具來說,此次發布正值一個有趣的時刻。零售行業一直在競相整合生成式人工智能功能,從 eBay 到小型初創公司,每個人都推出了自己的視覺搜索和人工智能助理工具。亞馬遜的優勢在於其龐大的產品目錄和購物數據,可以根據實際購買行為而不僅僅是瀏覽模式來訓練其模型。

真正的考驗將是 Lens Live 是否真的會改變購物行為,或者成為應用程序中另一個很少使用的功能。訪問該功能的早期採用者報告說,實時掃描感覺非常自然,特別是對於視覺相似性比精確匹配更重要的家居裝飾和時尚物品。只需點擊一下即可將商品直接添加到購物車或將其保存到願望清單而無需離開相機視圖,從而消除了發現到購買流程中的重大障礙。

注重隱私的用戶可能會喜歡初始對象檢測發生在設備上,儘管實際的產品匹配和 Rufus 交互仍然需要雲處理。亞馬遜尚未詳細說明存儲哪些視覺數據或如何使用它來改進服務,隨著更多用戶獲得該功能,這可能會成為一個更大的話題。

對於亞馬遜來說,Lens Live 不僅僅代表了一個很酷的技術演示,它還是一個捕捉當前逃離其生態系統的購物時刻的戰略遊戲。每當有人在現實世界中看到他們喜歡的東西但不知道如何搜索它時,這就是一次潛在的銷售因摩擦而丟失。通過使視覺搜索變得即時和對話,他們相信可以將更多轉瞬即逝的購物衝動轉化為實際購買。

該功能作為,加入其他最近推出的產品,例如個性化購物提示和人工智能生成的產品描述。這些工具共同描繪了亞馬遜對電子商務未來的願景:更少的打字,更多的發現,以及人工智能助手,即使您自己無法完全描述它,也能真正理解您正在尋找的東西。