Apple AI 是否足够安全以保护用户隐私?

iOS 18 的 Apple Intelligence深度融入系统的同时,也强调隐私保护。在Apple AI的支持下,Siri可以充分利用本地硬件实现更强大的AI能力。然而,苹果AI安全吗?它如何保证用户隐私?继续阅读以找到答案。

苹果软件工程高级副总裁克雷格·费德里吉 (Craig Federighi) 表示,苹果智能已经先进的隐私保护。而Apple AI的安全性主要是通过以下六种机制来实现的。

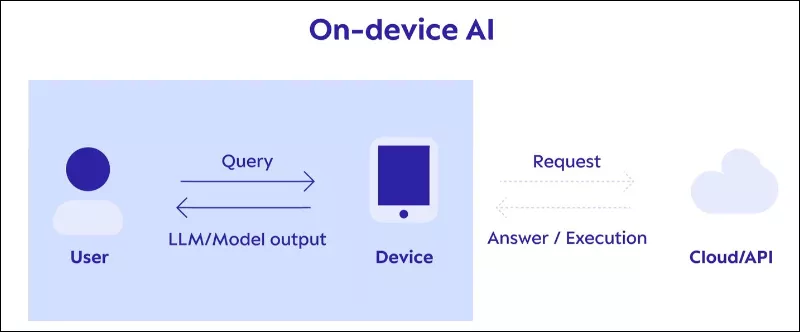

机制一:设备端处理

与严重依赖于传统人工智能系统不同云处理,Apple Intelligence 是设备上处理,类似于 AI PC 或副驾驶+电脑。这意味着人工智能计算,包括数据分析和模型推理,直接在用户设备上进行,而不是在外部服务器上进行。

设备上处理通过最大限度地减少传输敏感用户数据的需要来增强隐私保护。本地计算确保私人信息仍处于用户的控制之下。

这个功能需要强大的计算能力。这就是为什么人工智能苹果需要运行在A17 Pro、M1 和更新的处理器。

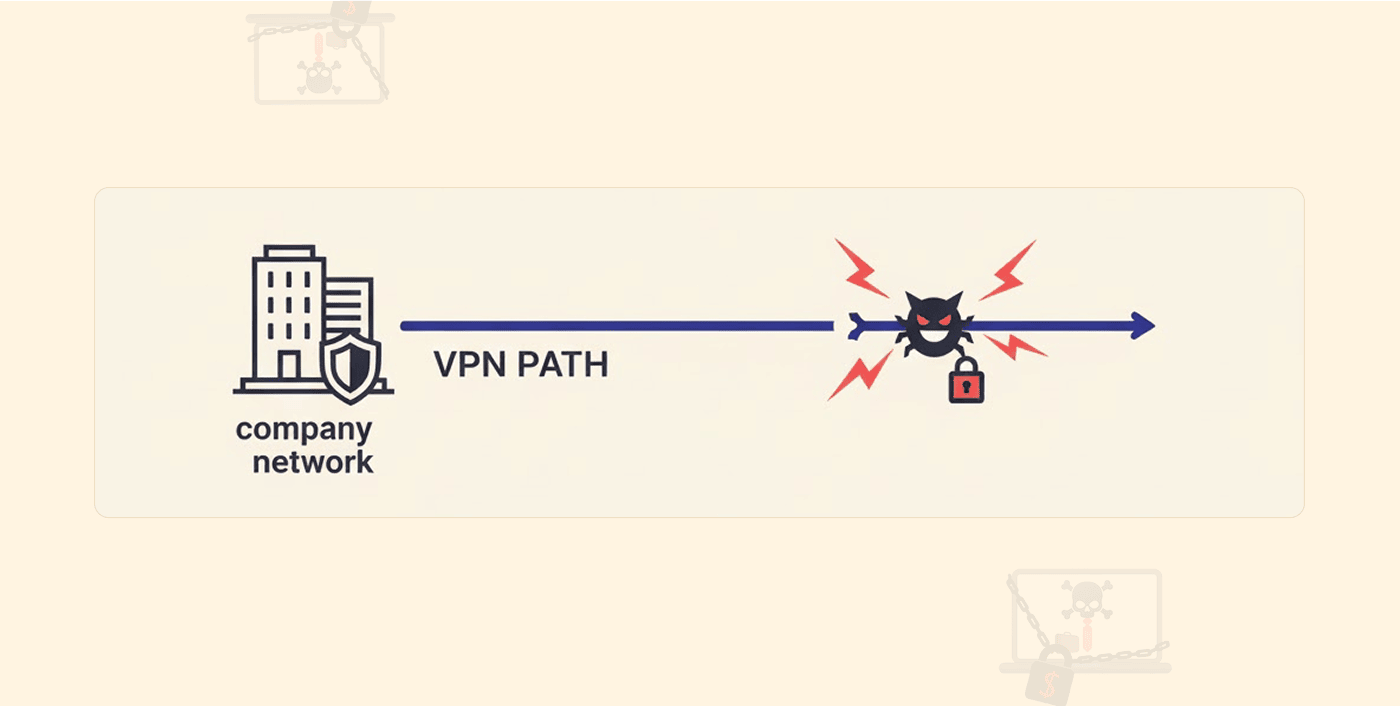

机制二:私有云计算

正如苹果公司的新闻稿所述:“Apple Intelligence 的基本原理是在设备上处理任务。但对于更复杂和要求更高的请求,私有云计算仍然会将 Apple 设备的隐私和安全性扩展到云端进一步拓展智能能力”。

Apple 使用安全、专用 Apple Silicon 服务器处理无法在设备上处理的复杂任务。此外,通过采用加密验证,只有具有公共可审核记录的服务器才被允许与 Apple 设备进行通信。

阅读更多:每个用户都应该启用 10 个 iPhone 隐私设置,以确保隐私不受影响

机制三:有限的数据共享且不保留

苹果确保当消费者向云服务器发送数据时,仅传输必要的信息。并且数据不会被保留。作为苹果人工智能承诺:“Apple 永远不会存储或访问您的数据。”

机制 4:独立代码审查

私有云计算的代码可供独立专家审查和验证其是否符合隐私标准。苹果强调了这一点的重要性独立的代码审查加强人工智能系统的安全和隐私。

机制五:数据加密

苹果会对所有数据进行加密,无论是进入还是离开其服务器。同时,苹果保证用户输入的数据不会被用作AI模型的训练数据,因此用户无需担心敏感信息泄露。

机制 6:选择退出的能力

用户可以选择是否选择Apple Intelligence。随着时间的推移,苹果将努力增强其人工智能能力。此外,Apple Intelligence还将提供多种供日常实际使用的Apple AI工具,这些工具将以测试版的形式发布。

结论

虽然苹果的人工智能将于今年秋季发布,其广泛使用还需要时间,因为许多用户可能需要升级他们的设备以支持新功能。苹果不断探索设备端智能和云端智能,这为苹果生态系统注入了新的活力。让我们一起期待未来的改变吧。